当記事の要点

- 中小企業の契約レビューは法務負担・コストともに高く効率化が急務

- GPTsを活用すれば非エンジニアでも契約チェックBotを構築可能

- 法的制約や個人情報管理を踏まえた設計・運用が重要となる

- 継続的なテストと改善で実用性・信頼性のあるBotが実現可能

こんにちは、FreedomBuildの駒田です。

中小企業の法務担当にとって、契約書のチェック作業は想像以上に重い負担です。

実際、月に20件以上もの契約書を1枚ずつ目視確認し、リスク条項の有無を精査する業務は、限られた人員と時間の中では効率化が難しいもの。

こうした中、注目を集めているのが生成AIとリーガルテックの融合による契約書チェックの自動化です。

特にChatGPTの「GPTs」を使えば、法務の専門知識がない担当者でも、自社専用のチェックBotをノーコードで作成できます。

この記事では、「GPTsって何?」「契約書のチェックはどこまで任せられるの?」という疑問に応えながら、中小企業でもすぐに使える契約チェックBotの作り方と注意点を、段階的に解説していきます。

法律リスクに対応しながら、日々の業務負担を減らす──その第一歩を一緒に踏み出しましょう。

契約書チェックが中小企業の重荷になる理由

中小企業にとって、契約書のレビュー業務は法務部門のボトルネックとなりやすく、実は経営に直結するコスト負担を抱えています。

月間数十件にも及ぶ契約書を、専門人材の限られた中で対応するのは大きな負担。

さらに、誤りや見落としが直接トラブルや損失につながるリスクも高く、「手間・コスト・リスク」すべてが集中する業務領域だと言えるでしょう。

以下では、その実情を4つの観点から掘り下げます。

契約審査が法務部門で最も時間がかかる業務

中小企業における法務部門では、「契約書の作成・審査」に最も多くの時間が割かれています。

とある調査では、法務担当者の64.2%が「契約業務に最も時間を取られている」と回答しており、単なる事務作業ではなく業務の中心になっていることがうかがえます。

これは以下のような要因に起因します。

- 契約内容の確認には法的知識が必須

社内規程や法律に照らして条項を読み解く必要があり、スピード対応が難しい。 - ひな形があっても100%そのまま使える契約は少ない

相手企業との交渉内容に応じて修正が必要になる。 - 複数部門との確認作業が発生する

営業・経理・管理職とのやり取りも含め、1件あたりの処理時間が長くなる。

こうした背景から、契約業務は一件ごとの負荷が高く、担当者の可処分時間を大きく削っています。

弁護士費用の高さと内製の限界

法務専門人材が社内にいない場合、契約審査は外部弁護士に委託する形となります。

このときに課題になるのが「スポット費用」と「顧問契約料」のバランスです。

| 手段 | コスト相場(参考) |

|---|---|

| 弁護士へスポット依頼 | 1件あたり5万~15万円 |

| 顧問契約(弁護士) | 月額5.2万円(平均) |

| AI契約チェックサービス | 月額1万〜7万円程度 |

費用を抑えるために契約書チェックを内製化する企業もありますが、「法務経験が浅い」「兼任担当者しかいない」といったケースでは、チェックの質が落ちてしまうリスクがついて回ります。

つまり、中小企業では「外注すれば高コスト・内製すれば高リスク」という板挟み状態になっているのが実情です。

月間平均20件、年間数百件のレビュー負担

契約書のやり取りは、業種や企業規模によって差はあるものの、月に10〜30件が一般的なボリュームとされています。

仮に月20件の契約書が発生すると、年間で240件。

1件に1時間かけるとしても、年間240時間の稼働が法務に吸い取られる計算になります。

とくに以下のような業務は頻度が高く、無視できません。

- 業務委託契約・秘密保持契約(NDA)

外部ベンダーとの関係で毎月発生する基本契約。 - 売買契約・取引基本契約

商材やサービスの提供先との都度契約。 - 雇用契約・請負契約

採用や一時的な人材活用に伴う書類確認。

このように、契約書レビューは企業活動に密接に関わるため、件数が少なくなることはほとんどありません。

見落としリスクが招く法的トラブル

契約書の見落としは、企業の命運を分ける可能性があります。

実際、LegalOn社の調査では契約実務担当者の7割以上が「過去に契約リスクを見落とした経験がある」と回答しており、手作業による確認には限界があることを示しています。

具体的には以下のようなトラブルが想定されます。

- 「抜け漏れ条項」が後日問題になる

損害賠償や解除条件が未記載のまま契約締結。 - 「不利な文言」がスルーされる

相手方に一方的な権利が与えられていたことに後で気づく。 - 「曖昧な表現」が認識の齟齬を生む

トラブルが起きた際に解釈で揉め、係争に発展。

こうしたミスは、企業の信頼失墜や裁判リスクに直結します。

小さな見落としが、数百万円単位の損害に膨れ上がるケースも珍しくありません。

このように、中小企業の契約業務には、時間・費用・精度の3軸すべてにおいて深刻な課題が存在しているのです。

生成AI × 法務の時代が到来している

AIの進化が「契約リスク管理」の現場にも本格的に波及しています。

これまで人間の目と経験に頼っていた契約書レビューの世界に、生成AIが大きな変革をもたらしているのです。

特に2023年以降、法務省によるガイドライン整備やGPT-4の登場を契機に、AIを活用したリーガルチェックの社会的受容性と実用性が急速に高まりました。

日本語対応のAIリーガルテックサービスが次々と登場し、「法務の生産性向上=生成AIで加速する」という構図がいま現実になろうとしています。

日本語対応のAIレビューサービスが急増中

数年前までAI契約チェックは一部の大企業向けツールに限られていました。

しかし現在では、中小企業でも導入しやすい価格・操作性を持つツールが次々と登場しています。

たとえば以下のような国内製AIサービスが注目されています。

| サービス名 | 特徴 |

|---|---|

| LegalOn Cloud | AIが契約書を自動レビュー。不利条項や漏れを色分けで提示 |

| GVA assist(OLGA) | 社内基準を登録して自社特化のレビューが可能 |

| LeCHECK | ブラウザアップロードだけで和文・英文契約書の即時チェック |

これらのツールでは、条文の抜け漏れ・不利な条件の検出・修正文例の提示などが自動化されており、人的チェックを補完する形で導入されています。

さらに、機能だけでなく「初期費用の安さ」や「セキュリティ体制の明示」なども評価され、法務部門がAI導入に踏み出すハードルが確実に下がってきました。

法務省ガイドラインで合法性が後押し

法的観点からも、AI契約レビューは一定の整理が進んでいます。

2023年8月に発表された法務省のガイドライン「AI等を用いた契約書関連業務支援サービスと弁護士法第72条との関係」は、その大きな転機です。

このガイドラインでは、以下のような整理がなされました。

- 営利目的のAI契約レビューでも、条件付きで合法

弁護士の最終チェックがあれば、AIの利用自体は違法とならない。 - 一般的な業務委託契約や売買契約などは「紛争性がない」とされ、AI利用が原則容認

裁判を前提としない契約であれば、AIによるレビュー提供は問題なし。 - AIの結果を「法的判断」と誤認させない設計が重要

ユーザーへの免責表示や利用規約での明示が求められる。

このガイドラインは「生成AIによる法務支援の合法ライン」を明確にし、開発者・利用者の双方にとって安心材料となっています。

結果、ツールベンダーの市場参入が加速し、ユーザー企業も導入判断をしやすくなっています。

GPT-4の性能は司法試験上位10%レベル

法務支援における生成AI活用の中心には、OpenAIのGPTシリーズが存在します。

特にGPT-4は、アメリカの司法試験(バー試験)で受験者上位10%に相当するスコアを記録し、法的判断力の高さを世界に示しました。

以下の比較からも、その進化の度合いは明らかです。

| モデル | 司法試験パフォーマンス | 日本語契約書対応 |

|---|---|---|

| GPT-3.5 | 下位10%程度 | 表現・法令解釈に課題あり |

| GPT-4 | 上位10%水準 | 日本語・法律用語にも対応可能なレベル |

GPT-4は、長文の契約書を読み解き、リスク条項の抽出や修正案の提示まで一定レベルでこなす能力を持っています。

日本国内でも、「日本語契約書の分析が十分可能な水準に達した」という評価が広がりつつあり、リーガル分野での応用が現実味を帯びています。

主要リーガルテックサービスとその進化

市場には、AI契約レビューに対応した複数のSaaSツールが存在し、それぞれに進化を遂げています。

その多くは、以下のような機能強化を軸に展開されています。

- 条文リスクの自動ハイライトと代替文の提示

- 契約書テンプレートの内蔵とAIによる自動ドラフト生成

- 社内ルールに即したカスタマイズチェック機能

たとえば「LAWGUE」は契約ドラフトの共同編集に特化し、「Hubble」は契約書の履歴管理や共有を支援するなど、ニーズに応じてサービスが細分化・最適化されてきました。

さらに、電子契約との統合や契約更新アラート、クラウド管理との連携も進んでおり、契約業務全体のデジタル化が加速度的に進行中です。

このように、生成AIと法務の融合はすでに実用フェーズに入りつつあり、中小企業でも手の届くものになっています。

次のステップは、「自社に合ったAI活用の形」をどう描くか──そこにかかっています。

GPTsで契約書チェックボットを構築する前に知っておくべきこと

GPTs(ジーピーティーズ)とはChatGPTの機能の一部であり、ノーコードでAIチャットボットが作成できる便利な機能です。

契約書レビューBotをGPTsで構築するにあたって、事前に押さえておくべき制約や操作ルールがいくつかあります。

特に、GPTsの仕様上の制限やユーザー権限の扱いは、開発後の運用やメンテナンスにも大きく影響するため、構築前にしっかり理解しておくことが成功の鍵です。

この章では、GPTs活用の前提条件と注意点を4つの視点から解説します。

GPTsの作成は有料ユーザーのみ可能

まず最初に押さえるべき点は、GPTsの作成は有料プラン加入者しか行えないという仕様です。

ChatGPTの無償ユーザーであっても、公開済みのGPTsを「使うこと」はできますが、自分でオリジナルのボットを作るにはChatGPT Plus(月額$20)以上のプランが必要です。

| プラン種別 | GPTsの作成可否 | 作成後の利用制限 |

|---|---|---|

| 無料プラン | ×(作成不可) | 使用可能(回数制限あり) |

| ChatGPT Plus | ○(作成可能) | 無制限に利用可能 |

特に契約業務での利用を想定する場合、作成後の反復使用や社内共有を前提とするため、有料プランは実質必須と考えておくべきです。

「マイGPT」から作成画面へアクセス

GPTsの作成は、ChatGPTの通常インターフェースから簡単に始めることができます。

具体的には、ChatGPTのトップ画面右上のアカウントアイコン → 「マイGPT」と進むことで、作成・編集画面にアクセスできます。

作成の手順は以下の通りです。

- アカウントアイコンをクリック

右上のプロフィール画像を選択するとメニューが展開されます。 - 「マイGPT」を選択

作成済みのGPT一覧が表示され、そこから「GPTを作成する」を選ぶと作成画面に遷移します。 - 名前・説明・命令文などを入力して保存

最低限「名前」と「指示(instructions)」が必要です。

アイキャッチ画像やナレッジファイルは任意で追加できます。

なお、この作成画面はURLをブックマークしておくと、後日すぐに編集作業へアクセスできて便利です。

また「マイGPT」ページでは作成したGPTsが時系列順に一覧表示されるため、過去の作業履歴も追いやすくなっています。

編集可能なのは作成者だけ(チームプラン除く)

GPTsの編集権限には制限があります。

基本的には「作成者本人のみが編集できる」設計で、他人のGPTsを編集することはできません。

これはセキュリティや誤操作防止の観点から重要な仕様です。

ただし、OpenAIの「チームプラン」に加入している場合は以下のような例外があります。

- チーム内の他メンバーも編集画面へアクセス可能

- チームから脱退すると、そのGPTsは編集不可となる

このため、複数人で契約レビューGPTsを管理したい場合は、あらかじめチーム環境での作成を検討しておく必要があります。

また、共有リンクを発行しても「閲覧・使用」はできても、「設定変更や修正」は共有相手にはできない点にも注意が必要です。

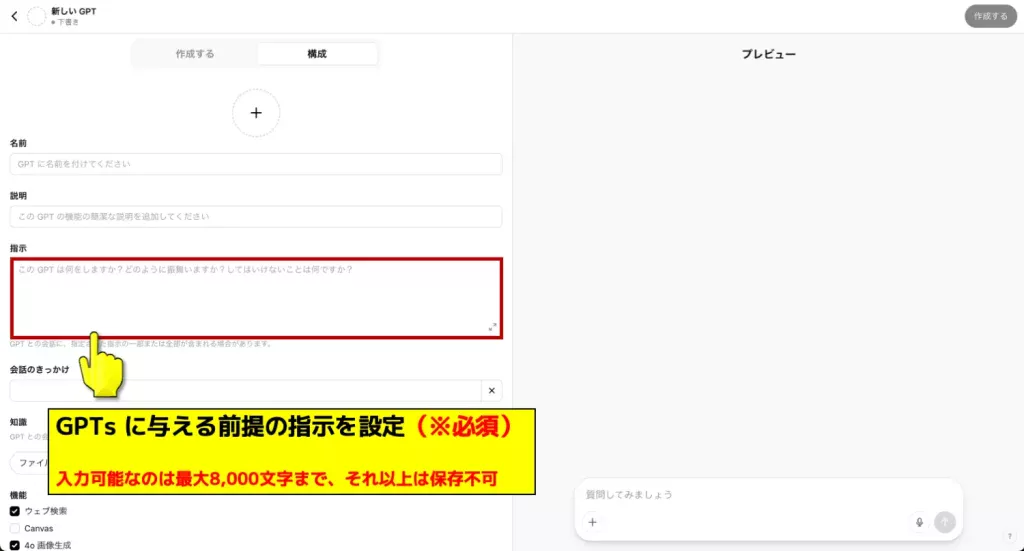

システムプロンプトの上限やナレッジファイルの扱い

GPTsには、事前の挙動を定義する「システムプロンプト」という設定欄があります。

ここに契約書レビューBotの性格・専門性・出力スタイルを細かく記述することで、ユーザーとの対話の精度を高めることが可能になります。

ただし、このシステムプロンプトには最大8,000文字までという制限があるため、それ以上の入力があるとGPTsの保存自体ができません。

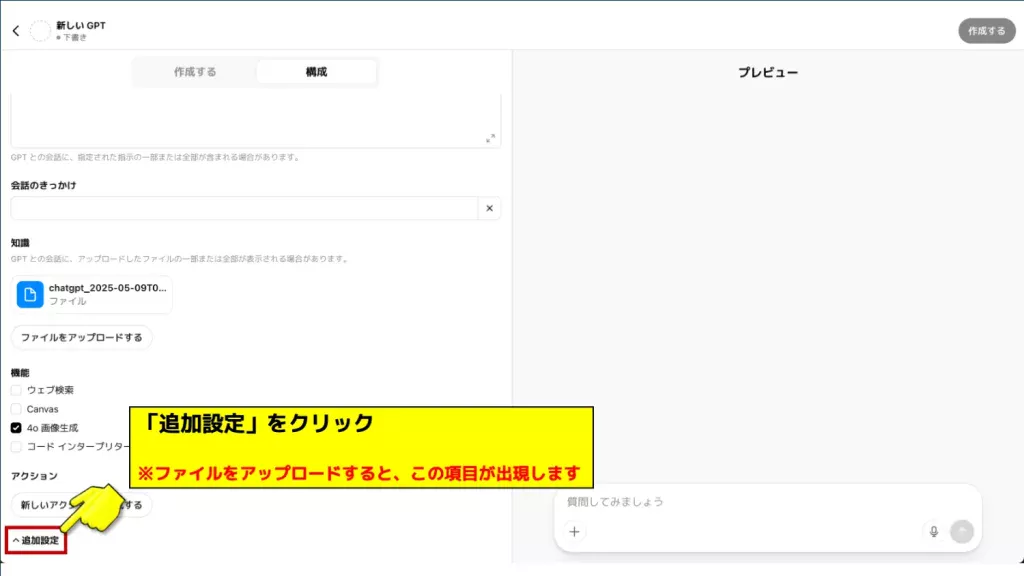

また、補助情報やチェックリストを追加したい場合は、以下のようにナレッジファイルを併用することが推奨されます。

- 対応形式:PDF / CSV / TXT / DOCX / MD など最大20種以上

- 1ファイル最大:512MB(CSVなら50MBまで)

- アップロード上限:1GPTあたり20ファイルまで

アップロードされたナレッジファイルは編集画面の「知識 ▸ ファイルをアップロードする」から設定可能です。

設定後は「機能」セクションで「コードインタープリターとデータ分析」をONにすることで、GPTがファイル内容を読み取り可能になります。

このように、プロンプトとナレッジファイルを組み合わせてGPTsの応答範囲を設計することが、ボット品質に直結する鍵となるのです。

GPTsを使った契約リスクチェックボットの構築ステップ

GPTsを活用した契約書チェックボットの開発は、専門エンジニアでなくても段階的に取り組める時代になりました。

ポイントは、GPTsが提供する「カスタム指示の登録」「ナレッジファイルの活用」「会話テストによる改善」という3本柱をうまく組み合わせることです。

この章では、実際にボットを構築する際の基本ステップを4つに分けて解説します。

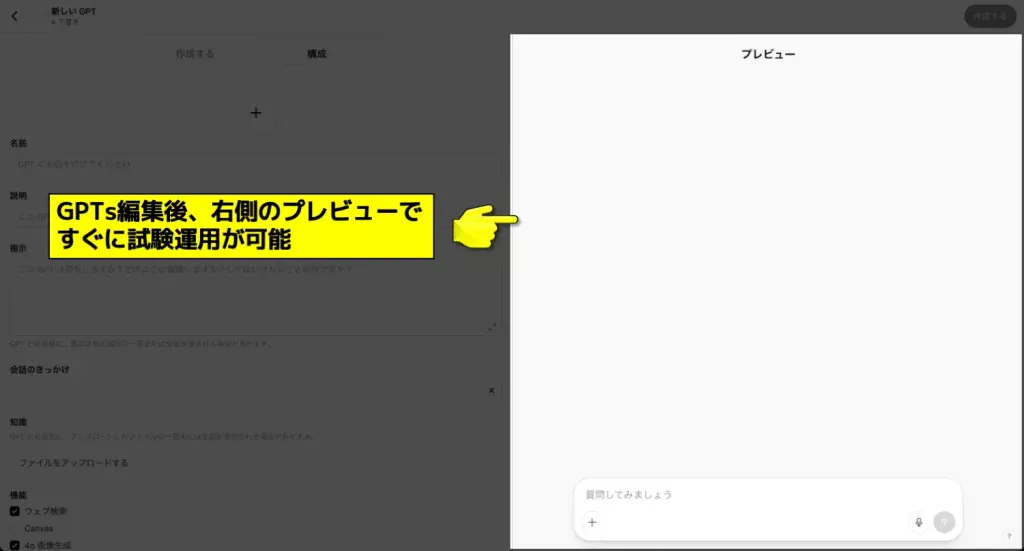

ステップ1:GPTs作成画面にアクセスし基本設定

まずはChatGPTのインターフェースからGPTsの作成画面へ移動します。

この作業は有料プラン(ChatGPT Plus)に加入している必要があります。

以下の手順で進めます。

- ChatGPT右上のアカウントアイコンをクリック

「マイGPT」というメニューを選択し、過去に作成したGPT一覧が表示されます。 - 「GPTを作成する」ボタンを押下

編集画面に遷移し、新しいGPTの設定が開始されます。 - ボットの基本情報を入力

名前・説明・指示文を順に入力します。ここで入力する「指示文」がボットの性格・役割を決定づけます。

この時点では、まだナレッジファイルの設定やUI調整は不要です。まずは「契約リスクをチェックするボット」としての役割を明示することが第一歩です。

ステップ2:契約書レビューの指示プロンプトを工夫

次に、ボットの核となる「システム指示(プロンプト)」を設計します。

この文面は、GPTsがユーザーとどのようなやり取りをするかを定義する重要な設定です。

たとえば、以下のような設計方針が有効です。

- 役割と対象を明確にする

「あなたは契約書チェックのアシスタントです。対象は中小企業のNDA・業務委託契約です」など。 - 出力形式を指定する

表形式でリスク分類を出力するか、リスト形式で列挙するかなど。 - 避けるべき表現を制限する

「法的助言ではない」「これは仮のレビューです」などの注意書きを常に含めるよう明示する。

システム指示には最大8,000文字という制限があるため、重要な要素を優先的に記述し、詳細なチェック項目はナレッジファイルに分離するのが望ましい設計です。

システムプロンプトの具体像として、以下にあくまで参考程度の設計例を示します。

実際の用途や社内方針に合わせて適宜カスタマイズしてください。

繰り返しになりますが、詳細な条文チェック項目などはファイルで補完する前提で構成しています。

system_instruction: >

あなたは中小企業向け契約書レビューアシスタントです。

ユーザーが入力した契約書本文をもとに、以下の要件に従って契約リスクの可能性を指摘してください。

このサービスは法的助言を行うものではなく、あくまでリスク箇所の例示と説明を提供する補助ツールです。

requirements:

contract_types:

- 業務委託契約

- 秘密保持契約(NDA)

risk_check_points:

- 責任の一方的偏り

- 損害賠償の上限規定の欠落

- 契約終了条項の不在または曖昧さ

- 秘密保持義務の一方的な偏り

- 準拠法・管轄条項の未記載

- 暴力団排除条項の欠落

output_format:

- リスクカテゴリ(例:損害賠償、秘密保持など)

- 該当条文(契約本文からの抜粋)

- コメント(なぜリスクと考えられるのか。可能な限り中立的・説明的に)

output_guideline:

- 出力はマークダウン形式の表を推奨

- 不明な場合は「情報不足により判断できません」と記載

- 指摘内容には「~の可能性がある」「一般的に注意が必要とされる」などの表現を用いる

notes:

- 法的評価や契約有効性の判断は行わない

- 最終的な確認は法務担当者または弁護士に委ねることを明記するステップ3:チェックリストやナレッジファイルを活用

より高度なレビューを実現するには、GPTsの「ナレッジ」タブにファイルをアップロードする仕組みを活用します。

これにより、GPTsが固定のチェックリストや専門用語集、条文例などを参照しながら回答できるようになります。

ナレッジファイルには以下の形式が対応しています。

| ファイル形式 | 想定用途 |

|---|---|

| .csv / .xlsx | リスクチェック項目一覧、条項対応表など |

| .pdf / .docx | 業種別の契約レビューガイドライン |

| .md / .txt | よくある契約リスクの事例集 |

アップロード後は、「コードインタープリターとデータ分析」機能をONにするのを忘れずに。

これを設定していないと、GPTsはファイル内情報を認識できません。

特にCSV形式のチェックリストを活用すれば、Botに「項目ごとのチェック可否を判定させる」設計も実現可能です。

また、チェック結果を構造化して返すようプロンプトと連携させることで、より信頼性の高い応答が得られます。

ステップ4:ユーザーとの会話例を通じて品質を検証

最後に欠かせないのが、対話テストによる動作検証とブラッシュアップです。

GPTs作成後はそのままChatGPT内でテストが可能なので、以下のような質問を投げて挙動を確認しましょう。

- 「この業務委託契約書の中で不利な条項はありますか?」

- 「この契約書に不足している項目があれば教えてください」

- 「顧問弁護士への確認が必要なポイントを抽出してもらえますか?」

このような実戦的な入力に対して、期待したアウトプットが得られるかを確認します。

回答に不備があれば、プロンプトやファイルを修正して再学習(アップロード)を行うことで改善できます。

GPTsの編集画面上で直接アップロードファイルの編集は行えません。

また、可能であれば社内の別ユーザーにも試用してもらい、フィードバックを反映することで、「実務にフィットしたGPTs」へと仕上がっていきます。

こうした一連のプロセスを踏むことで、実用性・再現性のある契約チェックボットが完成します。

あとは用途に応じて社内展開・チームプランへの移行など、実装フェーズへと進めばOKです。

GPTsを活用するためのセキュリティと法的配慮

契約書チェックボットをChatGPTのGPTs機能で構築・運用する場合、情報漏洩リスクや法的リスクへの配慮が欠かせません。

特に契約書のような機微情報を取り扱う以上、GPTsの仕様に即した安全な設計・運用ルールの整備が必要です。

この章では、GPTsの実行環境に最適化した法的・セキュリティ対策の要点を4つに分けて解説します。

法的責任を避けるためのBot設計とは

日本の法律では、弁護士以外の者が報酬を得て法律事務を行うことは弁護士法第72条で禁止されています。

GPTsで契約書チェックを行う際にも、この点への注意は必須です。

GPTsは「助言をするAI」ではなく、「判断材料を提示するツール」として明確に位置づけることが重要です。

次のような設計ガイドラインが有効です。

- 法律判断や断定的な表現を避ける

例:「この契約は無効です」といった断定はNG。「注意が必要とされる表現です」にとどめる。 - 出力内に補助ツールであることを明記する

例:「本ツールは契約内容の参考情報を提供するものであり、最終判断は利用者の責任にて行ってください」。

さらに、サービス利用規約や免責事項なども適切に設定し、法務リスクを未然に防ぐ構成にしておくことが大切です。

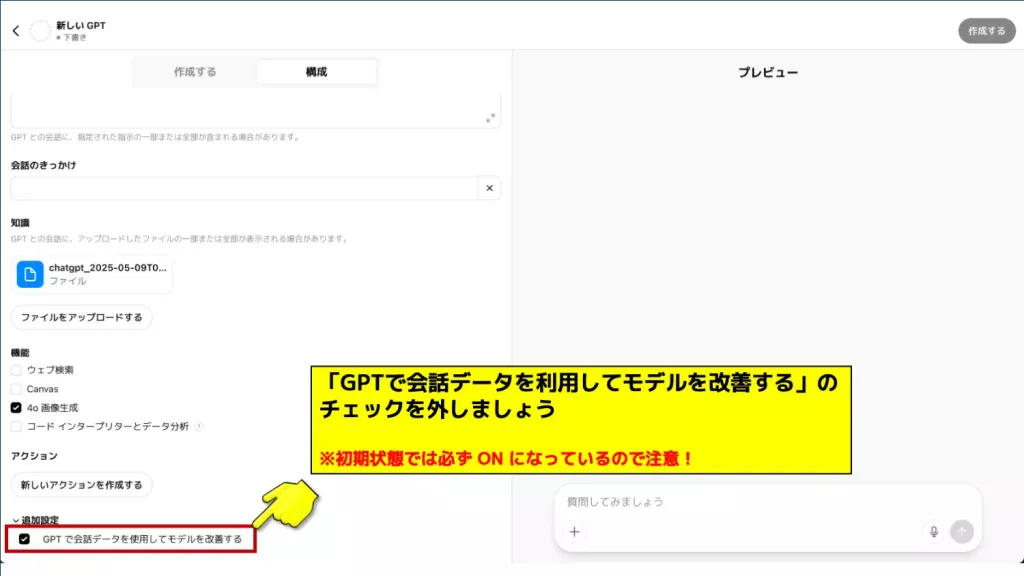

アップロードデータと会話履歴の管理方針

GPTsでは、ユーザーがアップロードした契約書ファイルや、やり取りされたテキストは「会話履歴」として一時保存されます。

初期状態ではOpenAI側がそのデータを学習に活用する設定になっている点に要注意です。

この挙動を制御するには、GPTsの編集画面で「会話データの使用」設定を必ずOFFにする必要があります。

| 項目 | 内容 |

|---|---|

| 会話履歴の保存 | ChatGPT UI上に表示されるが、学習目的で保存される可能性あり |

| OFF設定の場所 | GPTs編集画面 → 最下部「追加設定」→ チェックボックスOFF |

| 効果 | アップロードしたファイル・やりとり内容がAI学習対象から除外される |

ただし、履歴そのものはOpenAIのサーバーに最大30日間保存されることにも留意が必要です。

機密データをGPTsに読み込ませる際は、加工済みファイルの使用や履歴保持に関する社内合意も必要になります。

ファイルアップロード時の安全処理ルール

契約書チェック用のBotにファイルをアップロードする際は、ファイル内の個人情報や企業識別情報に対する事前処理が欠かせません。

安全な運用のためには以下のようなルールが有効です。

- 実名・社名のマスキング

「株式会社〇〇」→「A社」、「田中太郎」→「甲」などへの置換 - アップロード後の自動削除方針

GPTsではファイル自体の保持は行われませんが、ファイルを含むセッションの管理ルールを決めておくことが望まれます。 - 出力文の機密性レビュー

出力されたレビュー内容に、元データが含まれていないかのチェックを必ず行う。

また、機密度に応じて「レビュー前ファイル」と「公開用出力レポート」を分離して管理する運用も推奨されます。

組織全体で統一する社内セキュリティルール

技術的な制御だけでは、セキュリティ意識の徹底には不十分です。

GPTs活用を組織的に定着させるには、運用ルールの標準化と教育体制の整備が必要です。

特に次の3点を社内で明文化しておくと、トラブル回避に大きく貢献します。

- 誰がGPTsの作成・編集を担当するか

管理部門に一元管理させることで、不要なGPTsの乱立や設定ミスを防げます。 - 利用目的と範囲の明確化

「契約レビュー専用」「社内検討用のみ」など、利用範囲を限定し、出力の外部共有にはチェックフローを設けましょう。 - ファイル処理・削除のフロー化

アップロードから削除までの責任者・期限・確認方法を文書化しておくと、履歴の透明性が確保できます。

GPTsはあくまでChatGPT内部の機能であり、ユーザーが意識的に設定を変更・管理しなければセキュリティは担保されません。

技術設定と社内運用ルールを両輪で整備することが、GPTs活用の前提条件となるのです。

導入後の運用と改善ポイント

契約書チェックボットは、導入して終わりではなく「運用しながら育てる」タイプのツールです。

とくに法務分野では、小さな見落としが大きな損害に直結する可能性があるため、精度と信頼性の維持が重要です。

この章では、導入後の安定運用と品質向上を実現するために取り組むべき4つのポイントを整理します。

誤検出・見落としにどう備えるか

GPTsを用いたチェックでは、完璧な判定は期待できません。

実際の契約書には微妙な文言差や曖昧な表現が多く、AIが誤ってリスクと判断したり、逆に見落としたりすることもあります。

これに備えるためには、以下のような対策が有効です。

- 免責事項を出力文に含める

AIの判定は参考情報であり、最終判断は人間が行うことを明示。 - 高リスク箇所にはフラグを立てる

「顧問弁護士への確認推奨」といった注釈を付けて精査を促す。 - 事例ベースで再学習させる

見落としや誤検出があった文例をナレッジファイルに追記し、対応力を強化。

また、定期的にエラーログを収集・分析する体制を持つことで、長期的な精度向上にもつながります。

顧問弁護士との併用でリスクを最小化

AIは強力なサポート役ですが、最終責任を負うことはできません。

そこで、契約書チェックボットを本格運用する企業には、顧問弁護士の存在が重要なセーフティネットとなります。

たとえば、次のような併用が効果的です。

- 初期レビューはAIで実施

抜け漏れや表現の揺れを洗い出し、効率的に概要把握。 - 要注意ポイントのみ人間が精査

高リスクと分類された箇所だけを顧問弁護士に確認。 - 判定の差異をナレッジに反映

認識のずれがあった箇所はGPTs側に記録して次回に活かす。

このように「AIが先に目を通す→人間が判断する」という役割分担によって、チェックの速度と正確性を両立する体制が構築できます。

ユーザー教育とAI活用のトレーニング支援

いかに優れたAIボットを作っても、現場の担当者が正しく使えなければ本末転倒です。

とくに非エンジニアの現場職が操作する場合は、わかりやすい利用マニュアルや研修支援が不可欠です。

効果的な教育のためには、次の要素を意識すると良いでしょう。

- 入力方法のガイドを用意

契約書の貼り付け例、聞き方テンプレートなどを整備。 - よくある質問と対応パターンを共有

「この文言はAIがうまく読めない」などの注意点を社内で共有。 - 利用シナリオごとの事例集を提供

NDA、業務委託契約、売買契約など、用途別の使い方を例示。

こうした支援を通じて、AIの出力に対して「読み取り・判断・修正」ができる人材を育てることが重要です。

レポートやフィードバックを基にした継続改善

GPTsは一度作って終わりではありません。運用中に得られる対話ログやフィードバックこそが最大の資産になります。

改善サイクルの基本は次の通りです。

- ユーザーの質問傾向を定期チェック

どんな文言でつまずいているか、何が伝わっていないかを把握。 - 誤判定された例を記録

ケース別にナレッジを更新し、次回以降の出力に反映。 - 改善版を別バージョンとして保存

改修前のボットも残しておくことで、比較検証がしやすくなる。

また、重要な改善施策として「ユーザーからのフィードバックフォーム」を設置しておくと、現場の声を直接ボット品質に還元できる体制を築くことができます。

このように、契約リスクチェックボットの成功は、導入後の運用フェーズにおける“地道な育成”によって決まるのです。

安心して任せられるボットへと育てるためには、「使って、直して、また使う」サイクルを続ける姿勢が求められます。

まとめ

契約リスクの見落としや対応の遅れは、中小企業にとって致命的なトラブルの引き金になりかねません。

そうした背景の中で、GPTsを活用した契約書チェックBotの構築は、法務業務の効率化とリスク削減を同時に実現できる有力な手段です。

本記事では、GPTsの仕様や活用条件を正しく理解し、段階的にGPTsでBotを構築・改善していくプロセスを解説しました。

加えて、法的配慮やセキュリティ体制、ユーザー教育の重要性についても触れ、現場での実用に即したノウハウを整理しています。

「AIが契約書を見る」という選択肢は、もはや未来の話ではありません。

今すぐ、業務改革の第一歩を踏み出しましょう。